Un tweet sur 10 mentionnant des femmes politiques et des femmes journalistes noires, dans un échantillon analysé par Amnesty International, s’est avéré injurieux ou problématique, a déclaré l’organisation le 18 décembre, à l’occasion de la publication d’une étude novatrice sur les violences faites aux femmes sur Twitter réalisée par Element AI, fournisseur mondial de logiciels d’intelligence artificielle.

Plus de 6 500 volontaires dans 150 pays ont accepté de participer à Troll Patrol, un projet unique à caractère participatif destiné à traiter un très grand nombre de données sur les violences en ligne. Ces bénévoles ont trié 228 000 tweets envoyés à 778 femmes politiques et journalistes de sexe féminin au Royaume-Uni et aux États-Unis en 2017.

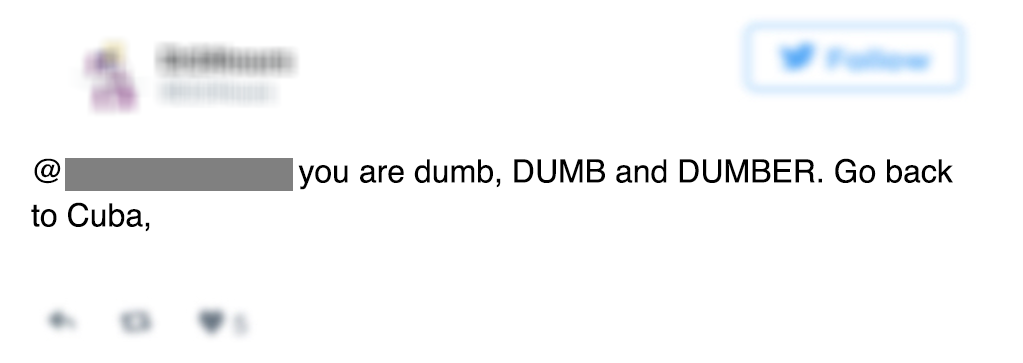

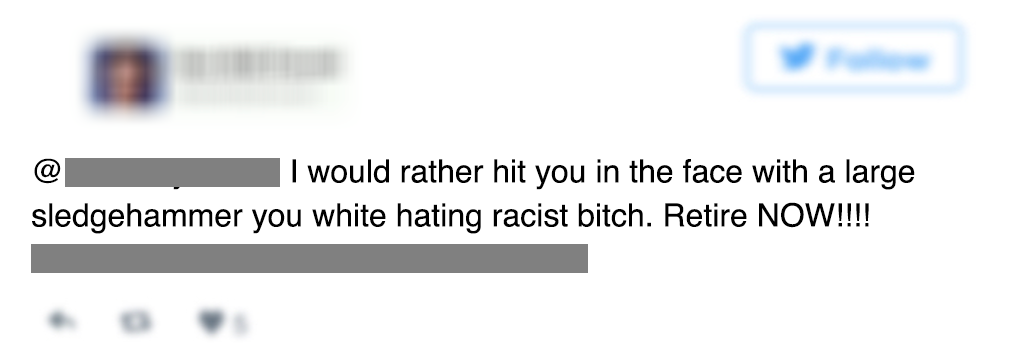

Grâce à Troll Patrol, nous disposons de données permettant d’étayer ce que les femmes nous disent depuis longtemps – que Twitter est un espace où on laisse le racisme, la misogynie et l’homophobie prospérer quasiment sans contrôle.

Milena Marin, conseillère principale sur les recherches tactiques à Amnesty International

Amnesty International et Element AI ont ensuite employé des techniques poussées de science des données et d’apprentissage automatique afin d’extrapoler les données sur l’ampleur des violences dont les femmes sont victimes sur Twitter. D’après les calculs d’Element AI, 1,1 million de tweets violents, injurieux ou problématiques ont été envoyés aux femmes sur la période de l’étude au cours de l’année – soit en moyenne un toutes les 30 secondes.

« Avec l’aide d’experts techniques et de milliers de bénévoles, nous avons constitué le plus grand ensemble de données du monde, collecté grâce à une démarche participative, sur les violences en ligne dont les femmes sont victimes. Grâce à Troll Patrol, nous disposons de données permettant d’étayer ce que les femmes nous disent depuis longtemps – que Twitter est un espace où on laisse le racisme, la misogynie et l’homophobie prospérer quasiment sans contrôle, a déclaré Milena Marin, conseillère principale sur les recherches tactiques à Amnesty International.

« Nous avons constaté que, si les violences ciblent des femmes de tous bords politiques, les femmes de couleur sont beaucoup plus susceptibles d’être touchées et les femmes noires sont ciblées de manière disproportionnée. En se montrant incapable de sévir contre ce fléau, Twitter contribue à faire taire des voix déjà marginalisées. »

Element AI a utilisé les données recueillies dans le cadre de Troll Patrol pour développer un modèle d’apprentissage machine d’une application qui vise à détecter automatiquement les tweets injurieux.

Element AI met son modèle à disposition pendant trois semaines afin qu’il soit testé, en vue de montrer le potentiel et les limites actuelles des technologies d’intelligence artificielle dans ce domaine.

« Cette étude s’inscrit dans le cadre d’un partenariat à long terme entre Amnesty International et Element AI. Adoptant une approche lucide vis-à-vis de l’intelligence artificielle, nous prenons des engagements sur le long terme, mettant nos experts et nos outils au service des acteurs du bien social, pour leur permettre de faire ce qu’ils savent faire de mieux », a déclaré Julien Cornebise, directeur des recherches ‘AI For Good’ et directeur du bureau d’Element AI à Londres.

Les femmes politiques qui composent l’échantillon viennent de tous les horizons de l’échiquier britannique et américain. Les femmes journalistes travaillent pour tout un éventail de publications britanniques et américaines, notamment The Daily Mail, The New York Times, Guardian, The Sun, GalDem, Pink News et Breitbart.

Principales conclusions

* Les femmes noires sont prises pour cibles de manière disproportionnée, ayant 84 % de risques de plus que les femmes blanches d’être citées dans des tweets injurieux ou posant problème. Un tweet sur 10 mentionnant des femmes noires a un caractère violent ou problématique, comparé à un tweet sur 15 pour les femmes blanches.

* 7,1 % des tweets adressés aux femmes faisant partie de l’étude ont un caractère injurieux ou problématique. Cela représente 1,1 million de tweets mentionnant 778 femmes sur l’année, soit un toutes les 30 secondes.

* Les femmes de couleur (noires, asiatiques, latinas et métisses) ont 34 % de risques de plus d’être mentionnées dans des tweets injurieux ou problématiques que les femmes blanches.

* Les violences en ligne à l’égard des femmes ne connaissent pas de frontières politiques. Les femmes politiques et les femmes journalistes sont confrontées à des niveaux similaires de violences en ligne et nous avons observé que les progressistes comme les conservatrices, et les médias qu’ils soient de gauche ou de droite, sont touchés.

Amnesty International a appelé maintes fois Twitter à publier des données sur l’ampleur et la nature des violences sur la plateforme, mais l’entreprise n’a pas pris les mesures nécessaires. L’ampleur du problème étant cachée, il est d’autant plus difficile de concevoir des solutions efficaces.

En menant des recherches participatives, nous avons pu réunir des éléments déterminants en une fraction du temps qu’il aurait fallu à un chercheur d’Amnesty International.

Milena Marin

Les bénévoles de Troll Patrol ont collectivement consacré – tenez-vous bien – 2 500 heures à analyser des tweets, soit l’équivalent d’une personne travaillant à plein temps pendant un an et demi.

« En menant des recherches participatives, nous avons pu réunir des éléments déterminants en une fraction du temps qu’il aurait fallu à un chercheur d’Amnesty International, et ce sans sacrifier le jugement humain indispensable lorsque l’on examine le contexte entourant les tweets, a déclaré Milena Marin.

« Le but de Troll Patrol n’est pas de rétablir l’ordre sur Twitter ni de forcer la plateforme à supprimer du contenu. Nous lui demandons d’être plus transparente et espérons que les conclusions de Troll Patrol l’obligeront à opérer ce changement. Il est crucial que Twitter se montre transparente sur la manière exacte dont elle utilise l’apprentissage machine pour détecter les violences, et publie des informations techniques sur les algorithmes mis en œuvre. »

Complément d’information

Les contenus injurieux ou violents enfreignent les propres règles de Twitter et incluent des tweets qui promeuvent les violences contre des personnes ou menacent des personnes en raison de leur origine ethnique, origine nationale, orientation sexuelle, genre, identité de genre, affiliation religieuse, âge, handicap ou maladie grave. Les contenus problématiques sont définis comme des contenus offensants ou hostiles – surtout s’ils sont envoyés à une personne de façon répétée ou cumulée – mais d’une intensité moindre que les tweets injurieux.

Amnesty International a fait part de ses conclusions à Twitter. En réponse, Twitter lui a demandé de clarifier la définition de « problématique », conformément à la nécessité de protéger la liberté d’expression et de rédiger les politiques de manière claire et précise.

Pour une méthodologie complète, veuillez vous rendre sur la page web interactive.